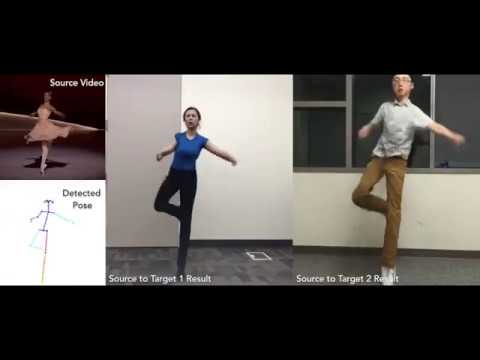

Caroline Chan, Shiry Ginosar, Tinghui Zhou en Alexei A. Efros van de University of Berkeley leveren met «Iedereen dans nu» niet alleen een interessante Wetenschappelijk artikel maar ook hoop voor alle bewegingsdyslectici wier dansstijl zich beperkt tot het tikken met hun voeten en hoofd. In zijn technische experimentele opzet helpt kunstmatige intelligentie om de bewegingssequenties van het sjabloon van een danser zo nauwkeurig mogelijk na te bootsen. Je moet de bewegingen in ieder geval grofweg nabootsen en de computer doet de rest. Natuurlijk ziet het er nog rudimentair uit en niet echt rond, maar het is behoorlijk indrukwekkend.

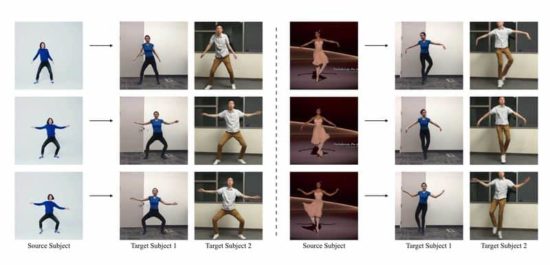

Dit artikel presenteert een eenvoudige methode voor 'doe wat ik doe'-bewegingsoverdracht: op basis van een bronvideo van een dansende persoon kunnen we die uitvoering overbrengen naar een nieuw (amateur) doelwit na slechts een paar minuten nadat het doelobject standaardbewegingen heeft uitgevoerd. We stellen dit probleem voor als een beeld-naar-beeld-vertaling per frame met spatio-temporele afvlakking. Door posedetecties te gebruiken als tussenweergave tussen bron en doel, leren we een mapping van pose-afbeeldingen naar het uiterlijk van een doelonderwerp. We passen deze opstelling aan voor tijdelijk coherente videogeneratie, inclusief realistische gezichtssynthese.

"Dravens Tales from the Crypt" betovert al meer dan 15 jaar met een smakeloze mix van humor, serieuze journalistiek - voor actualiteit en onevenwichtige berichtgeving in de perspolitiek - en zombies, gegarneerd met veel kunst, entertainment en punkrock. Draven heeft van zijn hobby een populair merk gemaakt dat niet in een hokje te plaatsen is.

"Dravens Tales from the Crypt" betovert al meer dan 15 jaar met een smakeloze mix van humor, serieuze journalistiek - voor actualiteit en onevenwichtige berichtgeving in de perspolitiek - en zombies, gegarneerd met veel kunst, entertainment en punkrock. Draven heeft van zijn hobby een populair merk gemaakt dat niet in een hokje te plaatsen is.